Nonostante l’allarme lanciato in tutto il mondo – una lettera aperta firmata da centinaia di leader del settore che dichiara l’intelligenza artificiale una minaccia esistenziale per l’umanità – un nuovo sondaggio condotto su oltre 2.700 esperti di IA dipinge un quadro del futuro meno disastroso.

L’indagine completa AI Impacts, condotta con l’aiuto di ricercatori delle Università di Oxford, Berkeley e Bonn, ha chiesto ai ricercatori di IA di valutare il ritmo dei progressi nel campo e l’impatto potenziale dei sistemi avanzati di IA. Sebbene sia stata raccolta un’ampia gamma di prospettive, solo il 5% circa ritiene che l’IA abbia un’alta probabilità di estinzione umana.

Questo dato è in netto contrasto con i sentimenti del pubblico in generale.

Un sondaggio dell’agosto 2023 ha rilevato che il 61% degli americani vede l’IA come una minaccia per l’umanità. A questa preoccupazione hanno fatto eco i leader del settore che hanno firmato una lettera del Center for AI Safety in cui si afferma che “mitigare il rischio di estinzione da parte dell’IA dovrebbe essere una priorità globale”.

Paul Christiano, ex capo dell’allineamento di OpenAI, ha stimato una probabilità del 50% che l’IA finisca in una “catastrofe”. Molti hanno dichiarato che l’IA è una minaccia pari alla guerra nucleare o a una pandemia globale.

Nonostante queste previsioni pessimistiche ampiamente diffuse, l’IA continua a evolversi. Le aziende stanno correndo per sviluppare sistemi più avanzati, con Sam Altman, CEO di OpenAI, che sostiene la necessità di una regolamentazione insieme alla spinta a testare i confini della tecnologia.

Per quanto riguarda le capacità dell’IA, molti intervistati hanno previsto che l’IA avrebbe raggiunto importanti traguardi creativi entro 10 anni: ad esempio, la codifica di un intero sito web di pagamento da zero o la creazione di canzoni indistinguibili dalle hit di oggi. Ma i tempi si allungano per sfide come la dimostrazione di teoremi matematici.

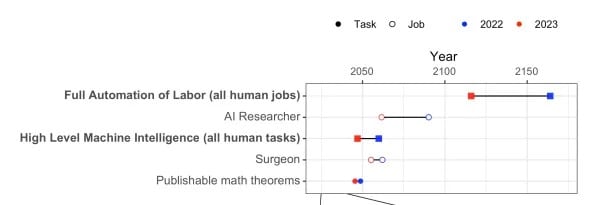

In particolare, la possibilità che l’Intelligenza Artificiale di Alto Livello (HLMI) diventi una realtà è stata avvicinata di 13 anni, con una probabilità di successo del 50% prevista per il 2047. Allo stesso modo, l’orizzonte della piena automazione del lavoro (FAOL) – una delle previsioni controverse di Elon Musk – è stato anticipato di 48 anni, al 2116.

Alla domanda sulla capacità dell’IA di eguagliare tutte le abilità umane, i ricercatori hanno previsto una probabilità del 50% entro il 2047. Si tratta di un anticipo di 13 anni rispetto a un sondaggio analogo condotto nel 2022.

Gli intervistati erano divisi se un progresso più rapido o più lento avrebbe portato maggiori benefici all’umanità.

È interessante notare che, mentre si prevede che i sistemi di IA del 2043 saranno in grado di trovare modi inaspettati per raggiungere gli obiettivi, i ricercatori hanno meno fiducia nella capacità umana di spiegare tali azioni. Questa ambiguità nel funzionamento del processo decisionale dell’IA evidenzia la necessità di dare priorità alla ricerca sulla sicurezza dell’IA, un sentimento che trova eco nel 70% degli intervistati.

Le opinioni divergono sul fatto che nel 2028 ci si possa fidare che l’IA spieghi i propri ragionamenti.

Esistono inoltre notevoli preoccupazioni riguardo a rischi come la disinformazione, la disuguaglianza e la sorveglianza di massa consentita dall’IA.

Sebbene i ricercatori siano complessivamente cautamente ottimisti, circa il 40% ritiene che ci sia una minima (non nulla) possibilità di estinzione umana a causa dell’IA avanzata. Quindi, anche se i robot assassini non sono imminenti, lo studio dell’etica e della sicurezza dell’IA resta fondamentale.