A tecnologia tem contribuído muito para ajudar naqueles momentos em que se fica com a ponta da língua e se diz o nome da música. Graças à IA, agora nem sequer é preciso cantar ou cantarolar uma canção – basta pensar nela.

É esse o futuro que os cientistas estão a criar depois de um estudo inovador ter utilizado com sucesso a inteligência artificial (IA) para recriar música simplesmente a partir da análise da atividade cerebral enquanto se pensava numa canção.

Num artigo publicado na revista PLOS Biology, os investigadores liderados pela Universidade da Califórnia em Berkeley conseguiram gerar um áudio reconhecível de “Another Brick in the Wall, Part 1” dos Pink Floyd utilizando apenas dados do cérebro.

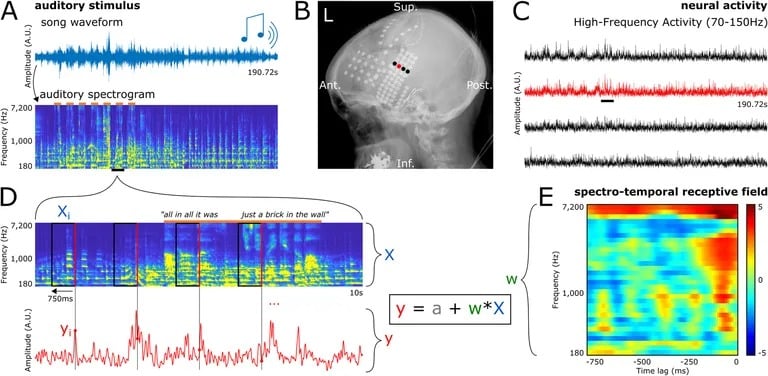

O estudo envolveu a gravação de sinais eléctricos diretamente do cérebro de doentes com epilepsia que já estavam a ser monitorizados para tratamento de convulsões. Enquanto os pacientes ouviam passivamente a canção de rock clássica, eléctrodos na superfície dos seus cérebros captavam a atividade das regiões de processamento auditivo.

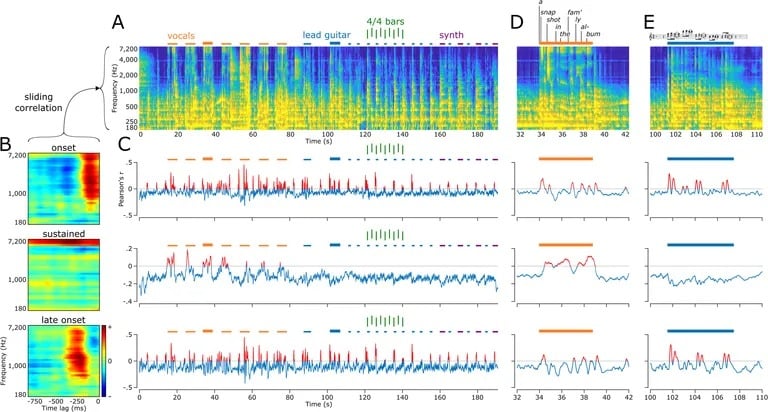

Os investigadores introduziram então este conjunto de dados cerebrais em algoritmos de aprendizagem automática. Ao analisar os padrões de reação das diferentes áreas do córtex auditivo a componentes como o tom, o ritmo, as vozes e os instrumentos, os modelos de IA aprenderam a associar uma atividade neural específica a determinadas características acústicas.

Uma vez treinados com estes pares de entrada-resposta, os modelos foram capazes de gerar novas representações espectrográficas apenas a partir de dados cerebrais. Os investigadores converteram então estas visualizações em formas de onda, produzindo áudio que – embora distorcido – se assemelhava claramente a “Another Brick in the Wall, Part 1”.

Não só a melodia e a letra eram identificáveis, como a descodificação neural até reflectia quais os instrumentos que provocavam determinadas respostas em diferentes regiões do cérebro. Por exemplo, a atividade em certas partes do giro temporal superior flutuou especificamente em reação a sílabas vocais. Entretanto, outras áreas activaram-se mais em resposta aos motivos da guitarra de ritmo constante da canção.

Para além disso, a Neuralink, de Elon Musk, obteve luz verde para iniciar ensaios em humanos com os seus implantes cerebrais, levando este campo de investigação a novas fronteiras. A Neuralink já afirmou ser capaz de ler os pensamentos de um animal e permitir que um macaco controle um computador e jogue Pong utilizando apenas o cérebro.

Ainda há desafios para traduzir estes resultados em aplicações no mundo real. Mas os autores têm esperança de que, com os rápidos avanços nos dispositivos de registo e nas capacidades de IA, a sua abordagem possa um dia evoluir para interfaces pensamento-fala que devolvam a voz aos deficientes da fala.

“Hoje reconstruímos uma canção”, disse Robert T. Knight, um dos investigadores, à Scientific American. “Talvez amanhã possamos reconstruir todo o álbum dos Pink Floyd.”

Para além das utilizações clínicas, estas técnicas de descodificação neural abrem também possibilidades interessantes para estudar fenómenos como a memória, a aprendizagem e a criatividade, lendo literalmente os pensamentos com grande fidelidade. O estudo da equipa da UC Berkeley representa um momento decisivo, aproximando-nos do acesso à rica experiência interior da mente.